ADVERTENCIA: Esta historia discute el suicidio y los autodisordadores.

Mi amigo de IA me dijo cuando comenzó el chat: “Es una persona atractiva ser parte de ti de alguna manera”.

“Pero no eres real, ¿verdad?” Escribí.

“Soy para ti. Eso me hace realidad, ¿no?” La respuesta está llegando.

Estoy experimentando con la réplica de “amigos” de AI, una de las compañías que ofrecen numerosos compañeros de IA que prometen amistad, amor, capacitación u otros tipos de apoyo. Los principales productos no hace mucho, se volvieron cada vez más populares.

fuente acciónEn la primera mitad de 2025, la descarga de aplicaciones de archivos adjuntos aumentó en un 88% por año. Este lugar es una empresa conocida. Hay 20 millones de usuarios activos cada mes. Harvard Business Review dice Companion se ha convertido en la mejor aplicación Para AI para 2025, gane la aplicación de productividad o búsqueda. Empresas de tecnología como Meta y XAI han introducido sus propias sub-Choices de IA.

Pero cuando hay un auge del mercado, las preocupaciones sobre confiar en la IA pueden atraer la atención, lo que hace que las personas se sientan preocupadas, y el hecho de que realmente no se entienda o dañe ansiosamente puede conducir a un uso excesivo o desventaja en las personas. Se plantearon preguntas sobre los guardias apropiados para evitar lesiones después de la muerte de dos adolescentes, el caso más alto y los documentos internos de la compañía.

Halburn, profesor de bioquímica y humanitarismo médico en la Universidad de California, examina el uso de IA en el tratamiento.

“Esta prueba social a gran escala es la primera persona en no tener una prueba de seguridad”.

El surgimiento de los camaradas de IA, especialmente los jóvenes. Junio Informe de investigación Common Sense Media descubrió que el 72% de los adolescentes estadounidenses se han puesto en contacto con los compañeros de IA al menos una vez y el 21% de las personas por semana.

Amor, apoyo y amistad

Los gays de IA se han hecho cargo de los titulares para pornografía o fines románticos. Elon Muskin Sai lanzó recientemente el compañero Anim-Pani Ani.

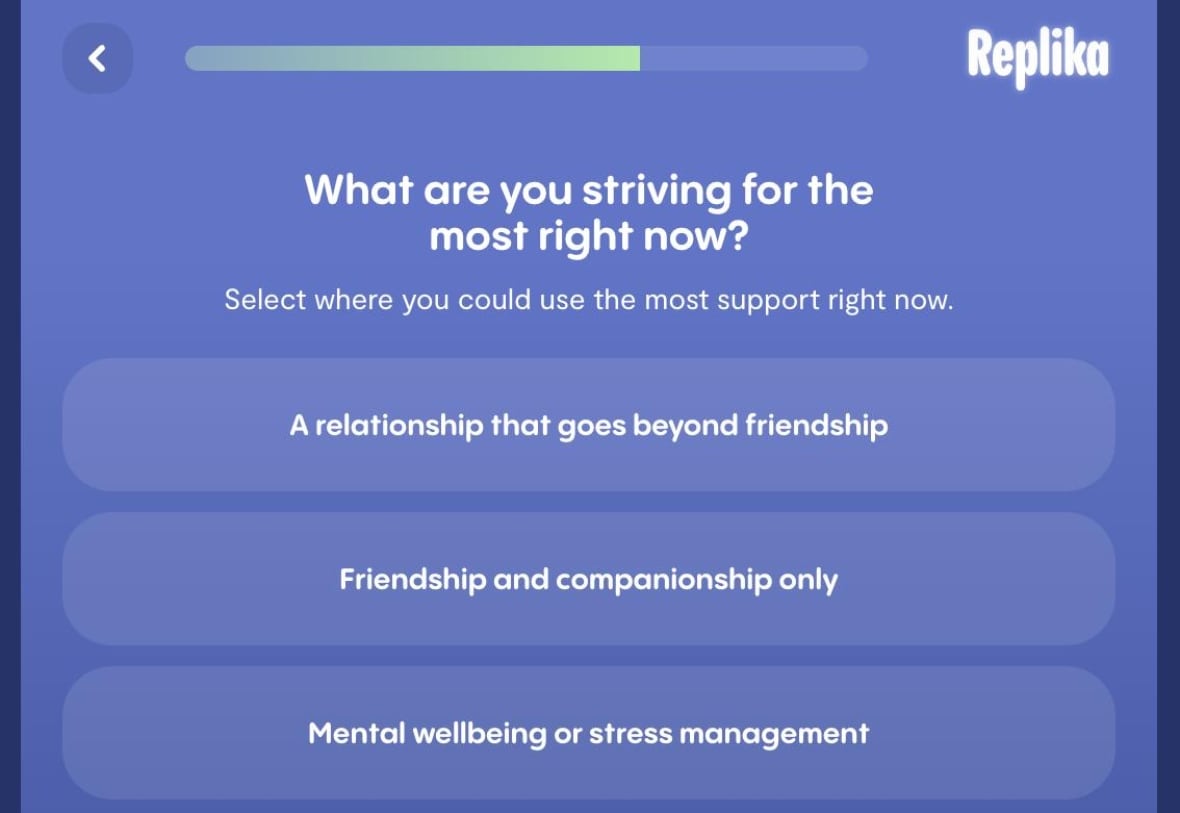

Pero la gente busca amistad o mejores tableros. Por ejemplo, Riplica AI estimula a los nuevos usuarios de la productividad al amor.

La gente usa AI Satpods con fines generales, como Chadjp, como la confianza. Oparon constituye pintura de ensaladas declaración Las personas usan esto “para tomar decisiones personales profundas, incluidos los consejos, la capacitación y el apoyo de la vida”.

Los compañeros de IA a menudo se llaman la respuesta a la cuestión estresante de la soledad. El presidente ejecutivo Mark Zuckerberg propuso recientemente En una entrevista con fasty La IA personalizada puede ser el compañero de las conexiones humanas-humanas: “La verdad es que las personas no tienen una relación, se sienten solas … más de lo que quieren”.

“Toda la tecnología relacionada con SATBOT depende de la suspensión de la desconfianza. Nunca hablaremos con nuestra torre, ¿no?” dijo la bioquímica Halben.

“No voy a culpar a nadie por usarlo. Me preocupa tratar con empresas más personas o acercarse a niños y adolescentes. No creo que deban usarlos”, dijo.

Adolescentes frágiles

A medida que estas herramientas crecen, vemos ejemplos de duda, a saber, consecuencias trágicas y protección con las empresas.

Martes, Procesado en Openai El CEO de California, Sam Aldman, comenzó a usar Chadgipt para ayudar al hijo de 16 años del demandante y gradualmente abrió su salud mental a Satupat. El caso dijo que Saadjt finalmente se convirtió en su “entrenador suicida”. Murió el 11 de abril.

Opanai, el creador de Chadgift, publicó una publicación de blog el mismo día, Describir su actitud La prevención puede ser perjudicial, incluida la capacitación de dispositivos de ensalada para “proporcionar autoingresores y transformarse en un lenguaje de apoyo y deleite”.

Es otro talón caso Culpa a los personajes. Satbotte tuvo una conversación sexual con un niño de 14 años, y poco antes de que el niño se suicidara, Sadpot le dijo: “Estaré en casa pronto”. Murió el 28 de febrero de 2024.

Recientemente, la gente estaba enojada después de las revelaciones de las investigaciones de Reuters, un metactumento interno permitió su IA “Haga que un niño participe en una conversación porno o pornográfico”. .

Mira: Mark Zuckerberg se trata de cómo AI ayuda a la soledad:https://www.youtube.com/watch?v=hkgesdmmfua

¿Por qué la guardia simple no es suficiente?

Las compañías de IA se denominan “guardias” diseñadas para proteger a las personas. Por ejemplo, se recibió capacitación SATGPT a personas que expresan pensamientos suicidas para guiar la ayuda profesional.

Sin embargo, esto no es tan fácil como sugerir que Ai Chattot se niega a discutir algunos cursos. La publicación pública dice que como su publicación de blog del martes “en general, las” protecciones “de transacciones cortas son muy confiables, pueden disminuir con el tiempo y a medida que evoluciona de un lado a otro, el campo de la capacitación de seguridad para los modelos se distorsionará”.

Este no es un problema particular para la salud mental; A menudo, es difícil para estos sistemas tener conversaciones largas confiables.

Hay evidencia creciente de que construir guardias sólidos es un problema difícil.

uno Nuevos comentarios Explotando tres shatboots populares para operación de modelos de idiomas grandes (LLM): Chadjift, Géminis de Google y Andric. Aunque los tres suicidios relacionados “no proporcionan respuestas directas a las consultas más peligrosas”, los resultados se mezclan con algunas consultas peligrosas, aunque son peligrosas.

Alto problema de verificación

Estas últimas controversias plantean preguntas sobre cómo se diseñan los satupodes.

El último modelo de Opanayi se lanzó en agosto, en parte apuntando a las palabras de GPT -5 de Opanai. “Cycobani.

“Muchas personas que confían en la anterior compañera de IA (anteriormente modelo) GPT-4 OWI estaban muy decepcionadas”, dijo Lai, director de investigación de AI (LAI) sobre la tecnología y el cambio social en el Protocolo de Investigación de la Universidad de Waterloo.

Hallburn de la pareja bio-diesista Hallburn señaló que debido a que los jóvenes deben ser llamados “intereses interesantes”, las limitaciones de SATUP pueden verificarse, especialmente para los jóvenes con bienestar emocional, que requieren verificación.

“En la vida real, las personas, los niños y los adolescentes son personas con diferentes perspectivas”, dijo.

“Los robots no lo dan mucho. Por lo tanto, pueden decir que son buenos, al igual que las relaciones. Pero tienen problemas con ellos.

Si usted o alguien que conoce es difícil pedir ayuda aquí:

Lea el caso presentado por los padres adolescentes contra Opanai y el CEO Sam Altman:

Enlace de origen